‘Moral Machine’ para coches autónomos

Desde los vehículos autónomos en vías públicas hasta los cohetes reutilizables no tripulados que aterrizan en buques autónomos, las máquinas inteligentes están apoyando o totalmente asumiendo actividades humanas cada vez más complejas a un ritmo creciente. La mayor autonomía dada a las máquinas inteligentes en estos papeles, puede llevar a situaciones en las que éstas tienen que tomar decisiones de manera autónoma, que afectan a la integridad física de humanos.

Esto requiere, no sólo una comprensión más clara de cómo los seres humanos toman tales decisiones, sino también una comprensión más clara de cómo los seres humanos perciben la inteligencia de la máquina tomando tales decisiones.

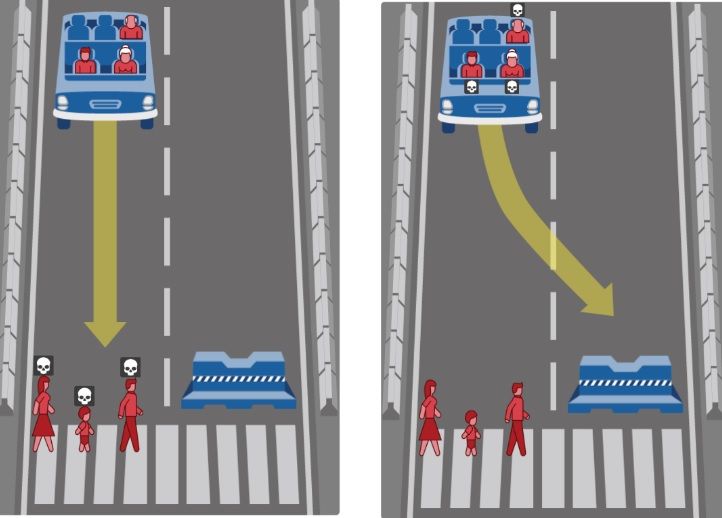

Estudios científicos recientes han puesto este asunto en los medios de comunicación y en el discurso público. ‘Moral Machine’ es una plataforma (http://moralmachine.mit.edu/hl/es) del prestigioso Massachusetts Institute of Technology (MIT), que pretende profundizar en la discusión proporcionando una plataforma para: 1) Construir una imagen multitudinaria (usando ‘crowdsourcing’) de la opinión de los humanos sobre cómo las máquinas deben tomar decisiones cuando se enfrentan a dilemas morales; y 2) permitir la construcción y discusión de posibles escenarios con implicaciones morales por una multitud de individuos.

‘Moral Machine’, que puede traducirse como ‘la moral de las máquinas’ a través de la simulación de situaciones críticas, en las cuales el usuario debe decidir qué hacer de acuerdo a sus convicciones o creencias, el experimento apunta a conformar una “ética general” para luego ser implementada en dispositivos que impliquen el uso de Inteligencia Artificial, como los automóviles autónomos.

La Inteligencia Artificial (IA) es un campo en crecimiento desde mediados del siglo pasado y, aunque con períodos más fuertes y otros más débiles, se caracteriza por su rápido progreso. En esta tecnología prima la transferencia de control propio de las personas hacia las máquinas. Es por ello que este proceso atraviesa una trama compleja en tanto conlleva implicaciones que se encuentran sujetas fuertemente a otras ‘cuestiones morales’.

Los seres humanos, como sujetos sociales, desarrollamos criterios éticos durante nuestro crecimiento e interacción con el otro, conformando un amplio y variado espectro donde se conjugan cuestiones culturales que le otorgan gran diversidad. Dichas cuestiones morales constituyen lo que pretende transferirse a las máquinas para que su autonomía esté complementada con esa información y así puedan tomar decisiones en situaciones críticas.

Se trata de una de las tareas más dificultosas que encuentra el desarrollo de la IA en determinados campos como, por ejemplo, su aplicación en los automóviles. La conducción autónoma ya es posible, pero los fabricantes y tecnólogos continúan trabajando para que esta metodología pueda fusionarse con las conductas humanas, es decir, conseguir que los dispositivos actúen a través de la ‘percepción humana’ ante situaciones límite.

Con el objetivo de buscar la autonomía en el control de los movimientos por parte de las máquinas, dotándolas de un complemento o soporte similar a la toma de decisiones que poseemos los humanos nació Moral Machine, una herramienta desarrollada por el grupo Scalable Cooperation en el Instituto de Tecnología de Massachusetts.

En este sentido, una de las funciones de este desarrollo está ligada a la recolección de datos. Ésta constituye una plataforma que propone diferentes escenarios, donde los usuarios deben decidir qué acción realizar ante una situación que implica un riesgo tanto para quien está dentro de la máquina que emplea esta tecnología (un automóvil o un tren), o para personas que se ven dentro de esta situación peligrosa sin tener relación con su uso.

Los escenarios presentados permiten al usuario emitir una opinión de cómo deben tomarse decisiones de manera autónoma que, luego de ejecutarse, generan un gran caudal de información para ser utilizada en investigaciones futuras enfocadas en las medidas automáticas de los dispositivos que empleen Inteligencia Artificial. Su éxito se basa en la recopilación de enormes cantidades de datos gracias a la gran convocatoria que posee la plataforma, lo que la convierte en un medio eficaz para la obtención de contenidos sobre ética de la IA: la participación pública se establece como pieza fundamental.

Director de ASEPA (Asociación Española de Profesionales de Automoción)

]]>

]]>